Der Deutsche Olympische Sportbund filtert mit Künstlicher Intelligenz Kommentare.

1.300 Beiträge wurden bereits markiert.

Einige davon direkt an die Staatsanwaltschaft weitergeleitet.

Und jetzt sollten bei jedem die Alarmglocken schrillen.

Nicht, weil Hass im Netz harmlos wäre.

Sondern weil hier eine neue Qualität entsteht:

Algorithmen entscheiden, welche Meinungen sichtbar bleiben –

und welche strafrechtlich verfolgt werden.

Was ist passiert?

Nach eigenen Angaben setzt der DOSB ein KI-System ein, das Social-Media-Kommentare automatisch überprüft.

Rund 1.300 Beiträge wurden als „problematisch“ eingestuft.

Ein Teil davon wurde gelöscht.

Ein anderer Teil offenbar direkt an Strafverfolgungsbehörden übergeben.

Die offizielle Begründung:

Schutz von Athleten.

Schutz vor Hassrede.

Schutz vor Diskriminierung.

Das klingt zunächst nachvollziehbar.

Doch die entscheidende Frage lautet:

Wer definiert, was Hass ist?

Und auf welcher Grundlage?

Wenn Algorithmen zu Schiedsrichtern werden

Künstliche Intelligenz bewertet keine Kontexte.

Sie erkennt Muster.

Wörter.

Sprachkombinationen.

Tonlagen.

Doch Meinungsfreiheit ist kein Algorithmus.

Sie lebt von Grauzonen.

Von Zuspitzung.

Von Kritik.

Von Emotion.

Wenn nun eine Organisation mit öffentlichem Auftrag beginnt, automatisiert Inhalte zu filtern und juristisch weiterzuleiten, dann verschiebt sich etwas Grundsätzliches:

Die Macht über den Diskurs wandert weg vom Bürger –

hin zu technischen Systemen.

Und hinter diesen Systemen stehen Menschen.

Mit eigenen Bewertungen.

Mit eigenen politischen Maßstäben.

Mit eigenen Definitionshoheiten.

Die unsichtbare Schwelle

Niemand weiß öffentlich:

Welche Kriterien die KI konkret nutzt.

Wie viele der 1.300 Kommentare tatsächlich strafbar waren.

Wie viele nur scharf formulierte Kritik enthielten.

Ob es Widerspruchsmöglichkeiten gibt.

Oder wie transparent das Verfahren ist.

Genau hier beginnt das Problem.

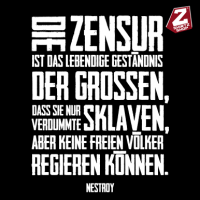

Denn Meinungsfreiheit stirbt nicht durch ein Verbot.

Sie stirbt durch Unsicherheit.

Wenn Menschen nicht mehr wissen, was sie sagen dürfen.

Wenn sie fürchten müssen, dass ein Algorithmus sie markiert.

Wenn Kritik vorsorglich unterbleibt.

Das nennt man „Chilling Effect“.

Und genau das ist das Risiko.

Der schmale Grat zwischen Schutz und Kontrolle

Natürlich: Beleidigungen, Bedrohungen, Volksverhetzung – all das ist strafbar.

Und das zu Recht.

Doch der Staat hat klare Verfahren dafür.

Richter.

Gesetze.

Beweisaufnahme.

Wenn nun private oder halböffentliche Institutionen beginnen, KI-gestützt Vorprüfungen vorzunehmen und Inhalte direkt weiterzuleiten, entsteht eine Vorfilter-Stufe.

Eine Art digitale Vorkontrolle.

Und die Frage lautet:

Wird hier nur Straftat verfolgt?

Oder wird hier bereits Gesinnung reguliert?

Ein Präzedenzfall mit Signalwirkung

Der DOSB ist kein kleiner Verein.

Er ist die Dachorganisation des deutschen Sports.

Wenn hier KI-basierte Inhaltskontrolle etabliert wird, dann hat das Signalwirkung.

Für Verbände.

Für Medienhäuser.

Für politische Organisationen.

Für Unternehmen.

Die Botschaft lautet:

Automatisierte Meinungsüberwachung ist normal.

Doch sie ist es nicht.

Sie ist ein massiver Eingriff in den öffentlichen Diskurs.

Transparenz statt Technokratie

Wenn solche Systeme eingesetzt werden, braucht es:

• Offenlegung der Kriterien

• Externe Kontrolle

• Einspruchsverfahren

• Klare juristische Nachvollziehbarkeit

• Veröffentlichung statistischer Details

Alles andere untergräbt Vertrauen.

Und Vertrauen ist die Grundlage jeder Demokratie.

Fazit: Die Debatte darf nicht verstummen

Es geht hier nicht um die Verteidigung von Hass.

Es geht um die Verteidigung eines Grundrechts.

Meinungsfreiheit schützt auch das Unbequeme.

Auch das Scharfe.

Auch das Provokante.

Wer KI zur Diskurskontrolle einsetzt, muss sich kritischen Fragen stellen.

Und zwar öffentlich.

Die zentrale Frage lautet:

Wollen wir, dass Maschinen vorentscheiden, welche Worte strafwürdig sind?

Oder halten wir am rechtsstaatlichen Prinzip fest, dass Menschen über Menschen urteilen?

Teile diesen Beitrag.

Diskutiere ihn.

Und stelle selbst die Fragen, die gerade gestellt werden müssen.

In Marla We Trust.

📚 Weiterdenken – Partnerlinks

(Affiliate-Hinweis: Die folgenden Links sind Partnerlinks. Wenn du über sie einkaufst, unterstützt du Marlas.Army, ohne dass dir Mehrkosten entstehen.)

1. Hannah Arendt – Macht und Gewalt

Analyse der Mechanismen politischer Kontrolle und öffentlicher Angst.

👉 https://amzn.to/3NDc0c8

2. George Orwell – 1984

Der Klassiker über Sprachkontrolle, Wahrheit und Überwachung.

👉 https://amzn.to/4bsO0SZ

3. Timothy Snyder – Über Tyrannei

20 Lektionen darüber, wie Demokratien sterben.

👉 https://amzn.to/3NcdiuI

Kommentar verfassen